公众号上线声音克隆,自媒体博主未来的数字永生

做公众号自媒体的同学应该知道,微信公众号官方一直有为公众号博主提供了一个移动端的公众号管理工具 :「公众号订阅助手」。

可以方便公众号运营在移动端管理自己的公众号素材、发布、甚至是其他相关的账户设置。

就在最近,一个博主分享了公众号订阅助手上线的一个新功能:朗读音色设置。

作为公众号的超级管理员,你将有权限调整自己的公众号文章的朗读音色。

熟悉公众号的同学都知道,在早些时候公众号已经上线了朗读模式,你可以点击阅读全文,公众号通过音频自动播放。

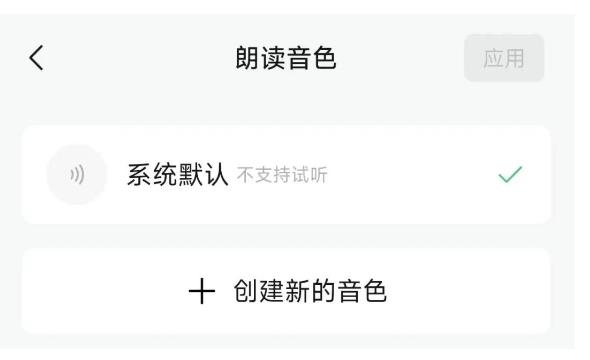

而这个音频的朗读人以前的版本是固定的,现在就朗读允许博主选择与创建了音色了。

而现在更新到2.29.1版本后,你有机会被灰度到。目前我的账户是没有被灰度到的,只有部分的公众号账户被灰度了。

比如我看到某些博主已经提前上线尝鲜,如下是公众号订阅助手的设置功能入口。

没有被灰度到的公众号订阅助手哦

公众号灰度支持朗读音色功能

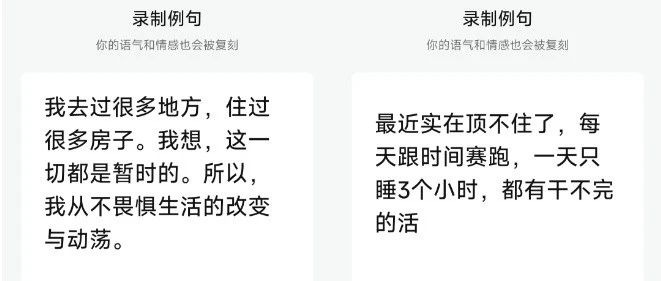

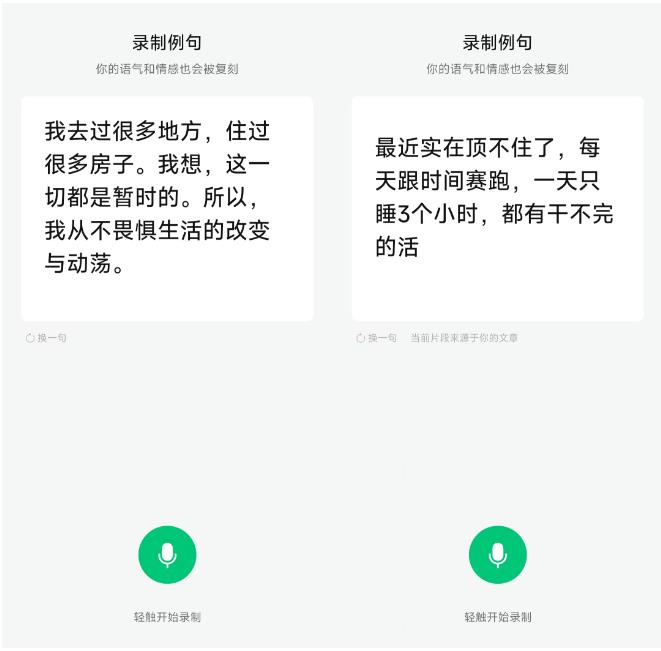

创建音色 图片来源:数字生命卡兹克

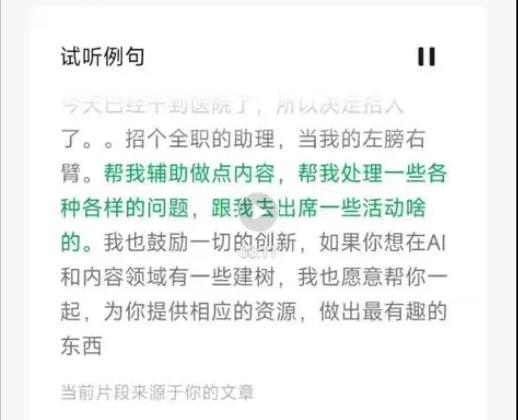

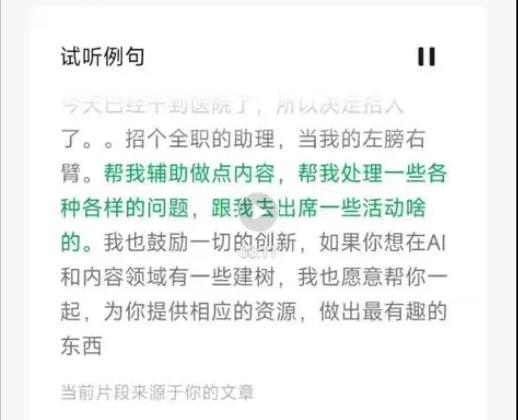

试听朗读,图片来源:数字生命卡兹克

选择创建的音频 图片来源 :数字生命卡兹克

2.克隆声音:Deep Fake技术

这项技术其实是AI的一个分支应用叫做deep fake,现在可以用于图像与声音上的克隆。

图片来自网络

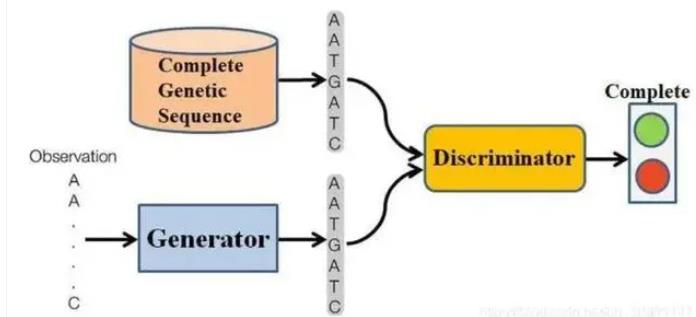

这项深度伪造技术的基础是GANS即Generative Adversarial Networks“生成式对抗网络”。在GitHub上有非常多的开源算法,产品经理随时可以调用与使用。

要实现deep fake技术,首先要建立一个自己的模型,而模型训练要经历6个步骤,声音和音频是各自的模型。

数据收集:首先需要收集大量的音频数据,微信自然有天然的数据优势(每天有如此多人适用微信语音消息)

特征提取:利用深度学习算法对收集到的音频数据进行特征提取,即找出语音的各种特征,如音调、节奏、音色等

生成模型训练:通过训练生成模型,将一个人的声音转换成另一个人的声音。这一过程通常需要使用到对抗生成网络(GAN)等技术

合成音频:将生成的声音与原始的视频或音频进行合成,以生成最终的Deepfake音频

音频同步:Deepfake技术还可以将音频与伪造的音频同步,使人物在伪造音频中看似说出特定的语句。(这就是

模型调优与验证:通过超参数调优和验证数据集测试不断提升模型的生成效果。例如调整生成器和判别器的学习率,或者增大训练数据集,以提高模型的泛化能力。

模型保存与部署:训练完成后,保存模型参数,便于进一步使用和优化,或将模型部署到实际应用中。

有了这样的模型后,用户只需要录入自己的声音,就可以快速生成,模型越精准,那么声音越像、时间越短、生成新素材所录入的素材越少。

博主提到的合规与风控

有博主解释到公众号的声音录入需要试读是因为合规与风控。

其实不是的。

Deep fake技术生成音频,需要有对应的音频输入,由此在朗读到一定素材后才能够用模型生成

作为产品经理,我们从上面的技术角度就可以知道,AI产品经理需要提供声音录入功能、以及声音校验的功能。

所以才会有对应:试读、以及试听例句。

用户对声音的反馈,反而再来进行模型的优化。

而作为AI产品经理,要想让用户使用这个功能,就必须为模型录入素材提供音频录入功能,考虑到内容版权的问题,最好的方式是选择博主自己“原创”的公众号文章。

这些文章既可以不需要担心「素材版权问题」还能够提供足够的各种音调、声音起伏、顿挫等阅读素材。

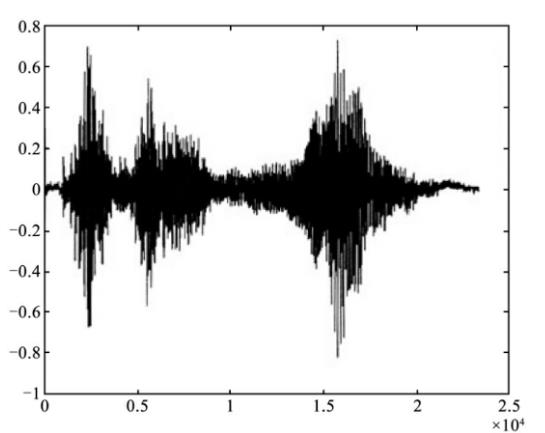

在音频解锁、声纹解锁上,也几乎都是同理,通过录入的声音进行声纹处理,将人类特有的声音声纹进行标注

声纹特点 图片来自网络

deep fake的AI模型,就是快速标注其声纹的各个人类声纹特点,训练deep fake模型需要大量质量好的素材,如果是音频就是音频素材,视频就是视频素材。

这就是为什么Deepfake的虚假内容最多发生在政客和演员身上,因为网上存有大量他们的图片数据。数据越多,效果越好,比如下面的刘德华、吴京、甚至是在速度与激情上使用的都是类似道理。

速度与激情保罗沃克

不仅是声音、还有画面,当然从deep fake技术的应用实战来说,画面的处理难度要比声音更难。

电影中deep fake技术体验

所以让用户录入自己的声音,是并不是因为合规与风控的要求。而是要使用这项技术,就需要用户录入声音。

而用户数据与训练模型都是在腾讯微信服务端上,完全不用担心别人会使用,除非有人攻击了微信腾讯服务器盗取数据。

当然还有一个方式

你可以利用第三方deep fake技术的APP,通过录入模拟的数字音频再次模拟,这在技术上可以的。

只是由于不是录入的真人声音,是再次基于deep fake技术生成的,自然会有缺失,同时你也不知道博主的家属亲戚联系方式,从理论上来说可以,实际操作上还是很难的。

今天的分享就在这里。